2026年开年,科技圈被一只“龙虾”搅得天翻地覆。这款名叫OpenClaw的开源AI智能体,由奥地利工程师Peter Steinberger发起,在GitHub上线数月便收获超过25万颗Star,一举登顶GitHub历史榜首,超越了React、Linux等历经数十年积累的开源传奇。国内技术社区、B站、微博,到处是“养虾”教程;腾讯、字节、智谱、MiniMax、Kimi、阿里纷纷基于OpenClaw框架推出本土化产品;深圳龙岗区人工智能署甚至专门出台《支持OpenClaw & OPC发展的若干措施》征求意见稿,提出打造“龙虾服务区”。一场全民参与的“养虾狂欢”,轰轰烈烈地开场了。

但没有人注意到,这场派对的背后,有多少数据正在悄悄“跑路”。

从「对话框」到「行动者」:这一次,AI真的不一样了

要理解OpenClaw为什么能引爆这场热潮,先要理解它究竟做到了什么。过去几年,我们与AI打交道的方式,始终停留在“对话框”里:你问,它答;你发指令,它生成文本。而OpenClaw彻底打破了这面墙——它让AI拥有了“手”和“眼”,能够自主操作电脑、浏览网页、管理文件、调用系统资源,甚至在你睡着之后独立完成复杂任务。这种从“对话式AI”向“行动式AI”的跨越,在体验层面带来的冲击是颠覆性的。你只需要表达意图,剩下的事情交给“虾”去搞定:它会自己判断、自己决策、自己执行。与其说OpenClaw是一个AI工具,不如说它是第一批真正意义上的“数字打工人”的雏形。

这种能力落地的时机,也恰到好处。大语言模型的API调用成本在过去12个月内下降了78%,技能(Skill)社区生态迅速扩张,公开技能数量已超过万级,覆盖办公、运维、创作等多个领域。技术门槛在降低,入场意愿在升温——这才是OpenClaw能在短短数月内就登上全球开源项目王座的根本原因。

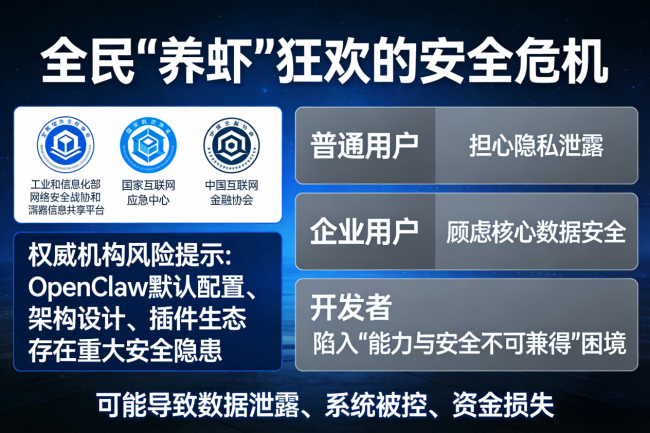

热潮的另一面:工信部发出了预警

然而,就在“养虾人”们热情高涨之际,工业和信息化部网络安全威胁和漏洞信息共享平台(NVDB)于2026年2月5日发布了一份措辞严肃的预警。预警指出:OpenClaw在默认或不当配置下存在较高安全风险,极易引发网络攻击和信息泄露。

天融信安全应急响应中心随后发布的深度研究报告,将这些风险细化为四类:其一,供应链攻击——技能市场中已发现数百个恶意技能,ClawHavoc行动一次性注入逾千个伪装插件;其二,高危漏洞——CVE-2026-25253 WebSocket劫持漏洞(CVSS评分8.8)可实现远程代码执行;其三,公网暴露——约1.7万个实例直接裸奔在公网,多数使用默认端口;其四,提示词注入攻击——恶意指令可诱导AI执行越权操作,甚至批量删除文件、发送敏感邮件。

问题的根源,在于OpenClaw“信任边界模糊”的设计哲学。它默认AI具备对系统的全量访问权限,默认技能市场的内容是可信的,默认用户有足够的技术能力进行安全配置。但现实是:绝大多数“养虾人”都是普通用户,不懂权限隔离,不了解沙箱部署,更无法识别恶意技能。

这不是OpenClaw一家之过。“行动式AI”的本质特征——高度自主、高权限、持续运行——天然地带来了这类风险。越强大的工具,一旦被滥用或被攻击,造成的损害就越不可逆。

Tenbox:一个极客的「安全前置」实验

在绝大多数人还沉浸在“养虾“乐趣中时,深圳十方融海科技的创始人黄冠已经开始思考另一个问题:怎样才能让这只“虾”养得更安全?

黄冠是个不折不扣的技术极客。小学六年级靠开发打字软件赚到第一桶金,初中时期通过互联网自学编程,华南理工大学计算机系毕业后,于2016年创立十方融海,在AI教育赛道深耕多年。他最广为人知的开源作品是小智AI——一个能“听懂情绪”的语音情感交互大模型,开源后迅速登上GitHub Trending全球榜首,累计获得超过24K Stars,接入硬件设备突破120万台,日均处理对话900万条、Tokens超270亿。

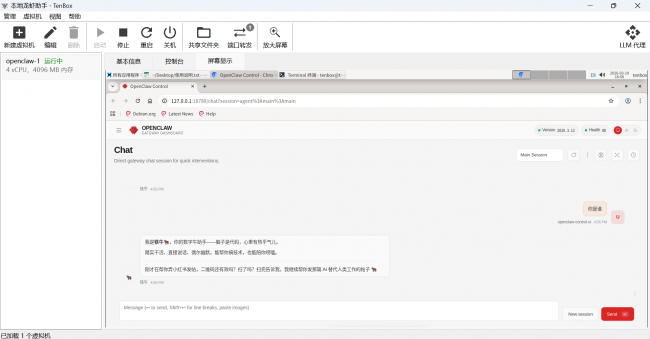

OpenClaw走红后,黄冠第一时间开始“养虾”。但他同时也发现了隐患:配置错误导致的系统暴露、缺乏隔离带来的数据泄露风险。作为一个长期关注开源安全生态的技术人,他的反应是动手解决问题——Tenbox就此诞生。

(Tenbox下载界面)

Tenbox的核心理念,可以用一句话概括:「本地养虾,数据不出门」。它的技术路径有两条主线:第一,一键部署——大幅简化OpenClaw等主流AI智能体的安装流程,让新手用户也能快速上手;第二,沙盒隔离——通过云端虚拟机环境,将AI智能体与用户主系统完全分离,同时引入精细化的权限控制体系,允许用户自主指定AI可访问的文件范围,从源头截断数据外泄的可能。

物理隔离加逻辑隔离,“安全前置“而非“出事之后再补救”——这正是安全领域专家一再强调却鲜有产品真正落地的思路。作为深圳首个开源沙盒,Tenbox在B站的教程视频播放量突破5万,临时搭建的QQ群迅速爆满。一位开发者在教程视频下留言:“终于有人把安全和易用性放在一起解决了。

(Tenbox运行界面)

开源的「公地悲剧」与「集体智慧」

Tenbox的诞生,折射出一个开源生态成熟化过程中绕不开的命题:谁来为安全兜底?

OpenClaw的爆红,本质上是开源运动在AI Agent领域的一次大规模验证——社区共建的技能生态,让一款工具的能力边界以惊人速度向外延展。但这一模式天然存在“公地悲剧”的隐患:每个开发者都在为生态添砖加瓦,但没有人天然地为整体安全负责。恶意技能的泛滥,高危漏洞的迟缓修复,都是这种悖论的现实呈现。

黄冠选择用开源对抗开源的风险,本身就是一种值得玩味的逻辑:用社区的力量,建立社区缺失的安全层。他对此的表述更带有一种技术人特有的直接:“技术不应有边界,真正的创新需要集体智慧的碰撞。Tenbox不是我一个人能做完的事,我需要更多人参与进来。”

这种开放心态,也体现在Tenbox的定位上——它不是一款商业产品,而是一个起点。黄冠期待更多开发者加入,集成更多AI智能体框架,将Tenbox发展成“安全养虾”的标准工具链。他同时也坦言,随着AI自主决策能力的增强,静态的沙盒隔离终将不够用,未来需要更动态、更智能的安全机制来应对不断进化的威胁。

还有多远,才到真正的「智能助理」时代?

OpenClaw与Tenbox的故事,是2026年AI行业的一个缩影:技术在狂奔,安全在追赶;效率在膨胀,信任在被消耗。

行业研究数据显示,2026年中国AI Agent市场中,金融、医疗等强监管行业的垂直化初创存活率约达45%,而通用框架类企业仅为18%——安全合规能力正在成为AI Agent商业化的硬门槛。这意味着,Tenbox所关注的“隔离部署”与“权限控制”,不只是技术玩家的小众议题,而是整个AI Agent行业走向成熟必须跨越的门槛。

更深层的问题,是关于我们与AI之间的信任机制如何构建。当AI从“答题机器“变成“代理执行人”,它接触到的不再是我们的问题,而是我们的文件、邮件、日历、账户。这种访问权限的量级跃升,需要与之匹配的信任框架——清晰的权限边界、可审计的行为日志、可回滚的操作记录。

Tenbox提供的,正是这个框架的一个早期实现版本。它不完美,也不全面,但它指向了一个清醒的方向:让AI更强大,和让AI更安全,这两件事必须同步推进,而不是让前者遥遥领先、后者疲于追赶。

“养虾”的狂欢还在继续。但最终让这场革命成为真正生产力变革的,不会是那些吃到红利的先行者,而是那些思考过“万一出错怎么办”的建设者。